О суперкомпьютере замолвите слово

Категории: Наука » Компьютеры » Обзоры

Суперкомпьютеры – как передовой авангард информационных технологий – вступают в фазу чрезвычайно важных перемен. Имеет смысл представлять, что это за перемены и почему они важны для всех

Категории и теги: Наука » Компьютеры » Обзоры » Суперкомпьютер, Масштабирование, Тера, Экза, Флопс, ТОП500, Прогнозы.

Каждый год в середине июня германский город Лейпциг принимает у себя главный форум всемирного суперкомпьютерного сообщества — International сomputer Conference 2013. По давно заведенной традиции в рамках этого мероприятия оглашается TOP500, то есть рейтинговый список полутысячи самых быстрых и мощных вычислительных систем планеты.

Понятно, наверное, что суперкомпьютеры, занимающие самые престижные верхние строчки в TOP500, — это не только предмет особой гордости государств, владеющих столь ценными хайтек-ресурсами, но еще и своеобразное зеркало, которое отражает самые передовые тенденции в области высокопроизводительных вычислений, или, кратко, HPC (High Performance Computing). Соответственно, ту небольшую группу людей, которым сообщество доверило работу по ежегодному составлению и редактированию списка TOP500, принято расценивать как наиболее компетентных и знающих специалистов в сфере HPC. Опять-таки по давней традиции соредакторами TOP500 являются четыре человека — два из Америки и два из Европы (в обозримом будущем, естественно, появятся и представители Азии, но пока этого нет). И неудивительно, что когда кто-то из редакторов TOP500 выступает с докладом о положении и тенденциях в отрасли, к его словам принято внимательно прислушиваться.

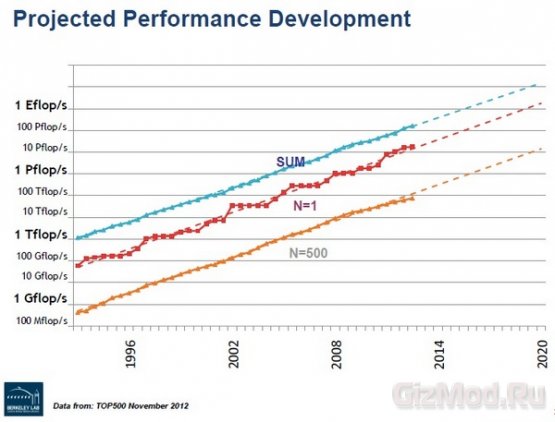

Удивительным же тут является вот что: примерно за месяц до начала ISC'13, в мае 2013-го, один из соредакторов TOP500 с американской стороны, Хорст Саймон (Horst Simon) два раза подряд выступил на конференциях помельче с одним и тем же, по сути, программным докладом, озаглавленным подчеркнуто вызывающе: «Вычисления экза-масштаба и почему мы их не получим к 2020 году» (интервью на ту же тему). Дабы вся необычность этого заявления стала понятнее для неспециалистов, можно пояснить два ключевых момента. Во-первых, на протяжении всей истории суперкомпьютеров рост производительности машин происходил с соблюдением (а иногда и некоторым опережением) известного закона Мура, согласно которому быстродействие вычислений повышается в 1000 раз примерно каждые 10-11 лет.

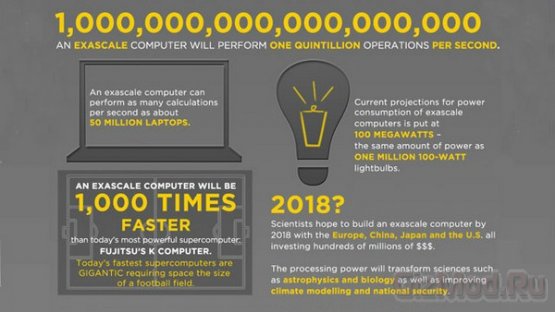

Во-вторых, психологически важный петафлопсный рубеж (1 петафлопс = 10*15 операций с плавающей запятой в секунду) был преодолен — как и планировалось — в 2008. Поэтому вполне естественно, что в суперкомпьютерном сообществе фактически по умолчанию уже принято рассматривать 2018-2019 годы как выход на следующий, экзафлопсный уровень вычислений (1 экзафлопс = 10*18 операций).

Рост производительности суперкомпьютеров и прогноз на будущее. Желтый цвет-машина на последнем месте в TOP500, красный-машина #1, голубой-суммарная производительность всех систем в TOP500.

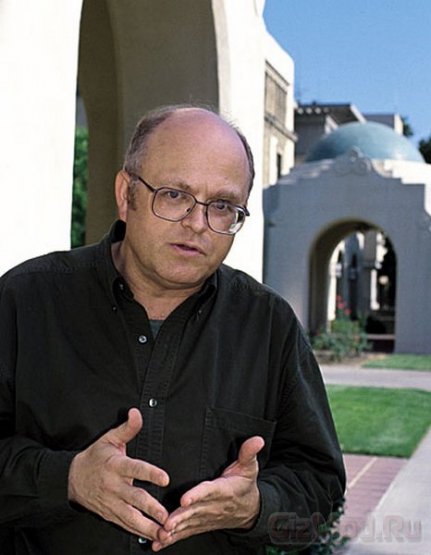

И тут вдруг поднимается солидный, всеми уважаемый научный авторитет Хорст Саймон (ныне заместитель директора LBNL, Национальной лаборатории им. Лоуренса в Беркли, известной, среди всего прочего, как один из главных суперкомпьютерных центров США) и ответственно заявляет, что никаких экзафлопсов, скорее всего, у человечества на этот раз не будет. Ни к 2018-му, ни даже к 2020 году... Если же принять во внимание, что ровно год назад, в мае 2012-го, другой весьма известный в суперкомпьютерном мире специалист из США, Томас Стерлинг (Thomas Sterling), также выступал с очень похожими по духу и выводам заявлениями, то явно имеет смысл прислушаться — о чем конкретно тут идет речь.

Ну а поскольку соображения и прогнозы второго эксперта прозвучали годом ранее, начать логичнее именно с него.

Предел Стерлинга

Широкой компьютерной публике Томас Стерлинг известен, в первую очередь, как отец популярной кластерной архитектуры Beowulf и как один из разработчиков первых петафлопсных систем. Или, иначе, как компетентный специалист, продуктивно занимающийся суперкомпьютерами вот уже более 30 лет. Здесь же к месту будет отметить, что и вся история суперкомпьютеров насчитывает чуть больше трех десятилетий. При этом, благодаря стремительным темпам прогресса, на три порядка повышавшего производительность машин каждое десятилетие, бытовой лексикон людей стал регулярно пополняться новыми «суперкомпьютерными» терминами.

Когда на рубеже 80-90-х годов для частоты процессора или байтов памяти накопителей только-только начали входить в обиход слова с префиксом «гига-» (обозначающим миллиард, или 10*9), у конструкторов суперкомпьютеров, замышлявших покорение следующего рубежа производительности, уже имелся соответствующий термин «тера-» для масштаба триллионов (10*12) операций. И когда к 1999 году в США была создана первая в истории компьютерная система, достигшая рекордной производительности 1 терафлопс, все чаще стал звучать термин «пета-» — как ориентир на следующий уровень быстродействия порядка квадриллиона (10*15) операций в секунду. К 2008 году, когда петафлопсный рубеж удалось преодолеть, соответствующий лексикон для будущих достижений суперкомпьютинга расширился очень значительно. После одного экзафлопса, или квинтиллиона (10*18) операций в секунду, запланированного к достижению на 2019 год, уже наметили компьютер производительностью один зеттафлопс (10*21, или секстиллион операций) — примерно к 2030 году. А кроме того, заранее запаслись терминами и для последующих вычислительных рубежей — йоттафлопс (10*24) и ксерафлопс (10*27). Проблема тут, однако, в том, что двигать прогресс супервычислений оказывается несоизмеримо сложнее, чем пачками придумывать новые термины.

И один из самых первых сигналов такого рода подал Томас Стерлинг. В своих публичных выступлениях весной и летом 2012-го он предупредил коллег по цеху, что ожидаемый уже в близком будущем переход к уровню экзафлопсных вычислений на самом деле будет выглядеть существенно иначе, нежели два предыдущих (тера- и пета-) перехода. Причем отличия эти имеют принципиальный характер. Стерлинг напомнил, что в начале 1990-х годов в компьютерной области произошла революция, одновременно предоставившая конструкторам дешевую DRAM-память, быстрые микропроцессоры, технологии объединения чипов в кластеры и тому подобные новые вещи. Стратегия на объединение всех этих прорывов в суперкомпьютинге оказалась в высшей степени успешной и работала несколько десятилетий.

Однако ныне та же самая стратегия уже не способна обеспечить переход к вычислениям экзафлопсного масштаба. Не получится это по той причине, поясняет Стерлинг, что средства и методы, прежде работавшие при данном подходе для повышения производительности, теперь уже не могут считаться адекватными. Потому что решение задач экзафлопсного масштаба подразумевает одновременное применение сотен миллионов процессоров, в которых параллельные вычисления предполагаются по миллиарду с лишним каналов. При такой сложности и громоздкости архитектуры эволюционные улучшения уже не работают, а революционных новаций в том же русле никем не предложено.

Иначе говоря, суперкомпьютинг ныне подходит к порогу следующего «фазового перехода» — и в делах программирования высокопроизводительных систем, и в вопросах проектирования их архитектуры, и в подходах к общему обеспечению их функционирования. Стерлингом проанализированы все стороны этой огромной проблемы. Но дабы не вдаваться в малопонятную для неспециалистов техническую аргументацию, достаточно проиллюстрировать масштаб трудностей лишь одним примером — чудовищными энергетическими затратами на супервычисления.

По самым грубым прикидкам, на 10 петафлопс производительности ныне затрачивается порядка 10 мегаватт электроэнергии. Этого количества достаточно для питания, к примеру, 4-5 здоровенных торговых центров вроде тех, что ныне строят в пригородах мегаполисов. При типичных тарифах на электроэнергию порядка 10 центов за киловатт это составляет 1 000 долларов в час, или без малого 10 миллионов долларов в год (не считая стоимости охлаждения и обслуживания). Ну а дальше еще хуже — если грядущая система экзафлопсного масштаба будет создаваться примерно на тех же конструктивных принципах, что и нынешние петафлопсники, то она станет потреблять уже порядка 2 гигаватт электричества.

Такие цифры, для справки, примерно соответствуют энергии, вырабатываемой ядерной электростанцией среднего размера. Понятно, наверное, что для питания единственного компьютера — пусть даже «супер-супер» быстрого — чрезвычайно сложно признать такой вариант приемлемым...

Пари Саймона

Переходя от прошлогоднего выступления Стерлинга к нынешнему докладу Саймона, сразу следует отметить, что они последовательно и согласованно дополняют друг друга по всем ключевым позициям. При этом существенно, что хотя и Томас Стерлинг в госструктурах США человек весьма известный (не раз приглашавшийся в качестве консультанта и в Агентство национальной безопасности, и в Пентагон, и в NASA), государственный масштаб, так сказать, Хорста Саймона куда более значителен.

Будучи уже признанным экспертом в мировом сообществе компьютерных ученых и прикладной математики, Саймон в середине 1990-х был назначен директором только что созданного NERSC, Национального научно-компьютерного центра энергетических исследований США. Поскольку базой для Центра в 1996 году стала Berkeley Lab, с той же поры началось и сотрудничество ученого с LBNL.

В последующие годы Саймон стал основателем и первым директором Вычислительного исследовательского подразделения Berkeley Lab, а затем и ассоциированным директором Лаборатории по компьютерным наукам. Иначе говоря, во многом благодаря именно ему центр Berkeley Lab сегодня считается общепризнанным в мире лидером в делах, касающихся суперкомпьютерного обеспечения для поддержки научных исследований в самом широком спектре дисциплин. Все эти этапы большого пути вспоминаются здесь для того, чтобы стало понятнее, почему доклад Хорста Саймона — о больших проблемах с прогнозами на близкий экзафлопс — вызвал в суперкомпьютерном сообществе куда более заметный резонанс, чем прошлогодние предупреждения Стерлинга. При этом Саймон — как редактор TOP500 — выбрал и более конкретный способ аргументации, отталкиваясь от тех вычислительных систем-чемпионов, которые на сегодняшний день занимают три самые верхние строчки в рейтинге мощнейших компьютеров планеты.

Случилось так, что три этих системы построены на основе трех существенно различающихся архитектур и как бы воплощают в собе главные конкурирующие направления для движения к будущему вычислителю экзамасштаба. Однако, подчеркивает Саймон, слабые стороны каждого из подходов понимаются хорошо, но при этом нет никакой ясности с тем, какая из архитектур способна привести нас к экзафлопсной машине. Каковы же конкретнее эти три разных маршрута?

В общепринятой технической терминологии один из этих путей называется «мультиядерным» (multicore path) и построен вокруг самых передовых, хай-энд-процессоров в линейках Intel x86, SPARC и IBM Power 7. Второй путь, под названием «многоядерный/встроенный» (manycore/embedded), ориентирован на множество более простых и относительно маломощных ядер в процессорах для встроенных систем. Наконец, третий подход «GPU/акселератор» (GPU/accelerator path) использует в высшей степени специализированные процессоры из рыночного пространства видеоигр и графических приложений, такие как NVIDIA Fermi, процессор Cell и Intel Xeon Phi (MIC).

В новейшем TOP500 этим подходам соответствуют три системы в высших строчках списка. В частности, Titan, система номер 1 из Национальной лаборатории США Oak Ridge, использует подход «ГПУ/акселератор». Позицию номер 2 занимает система Blue Gene, воплощающая собой «многоядерный/встроенный» подход. Ну а система номер 3, японский компьютер К, использует «мультиядерный» подход на основе процессоров SPARC.

Высказывая свое личное мнение эксперта, Саймон дает такие прогнозы относительно дальнейших перспектив для этих конкурентов. Очень похоже, считает он, что «мультиядерный вариант» ведет нас в тупик (что подтверждается недавним решением IBM аннулировать свой контракт на создание системы Blue Waters, мыслившейся как очередное воплощение мультиядерной идеи). Для второй идеи — «многядерных/встроенных» систем — дело идет к тому, что нынешняя машина Blue Gene станет, судя по всему, и последней в этой линии вычислителей. И пока совершенно неясно, появятся ли в будущем другие машины такого рода. Что же касается третьего подхода, «ГПУ/акселераторы», то этот маршрут сегодня развивается наиболее динамично. В частности, корпорация Intel ныне энергично закупает соответствующие технологии, и очень похоже, что там намерены создать полную суперкомпьютерную систему с прицелом на первое место в TOP500. Короче, если говорить о ближайших перспективах, то Хорст Саймон готов биться об заклад, что уже к 2015 году все 10 самых мощных систем в TOP500 будут основаны на архитектуре «ГПУ/акселератор». Вот только экзафлопсную машину на этом пути, увы, просто так — масштабированием системы — уже не построишь...

Многие годы находясь в самом центре нескончаемых гонок конкурентов за первые места в рейтинговом списке, Хорст Саймон, похоже, уже насквозь пропитался азартом этих соревнований. И осознанно или нет, но любые свои прогнозы переводит на язык пари. Так что и здесь, как только Саймон ответственно выдал свой пессимистичный прогноз — что до 2020 года никому не удастся построить машину, которая займет в TOP500 место номер 1 с максимальной скоростью работы свыше экзафлопса — он тут же заключил соответствующее пари с физиком Томасом Липпертом (Thomas Lippert), главой германского суперкомпьютерного центра Julich, и в основе его — заявление Саймона, что человечество не достигнет этой цели к ноябрю 2019-го. Пари заключено на 2 000 доларов или 2 000 евро, и Саймон уверен, что выиграет. Однако тут же подчеркивает, что предпочел бы его проиграть, если кому-то вдруг действительно удастся построить экзафлопсную машину к тому времени...

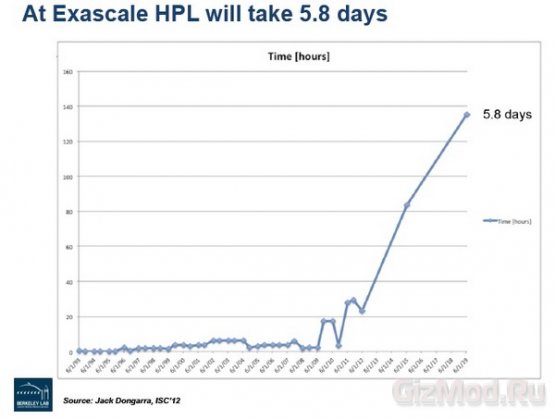

Если же разбираться с тем, откуда эксперт черпает свою уверенность, то сразу надо отметить что экзафлопсная машина — это не одна большая техническая проблема, а скорее целый комплекс тяжелых проблем. Начать можно с того, что даже измерение производительности такой системы — само по себе непростая задача. Прогон стандартного набора тестов LINPACK, с помощью которого ранжируют машины в TOP500, — это и для машин-чемпионов нынешнего петафлопсного масштаба очень непросто. Администрация должна полностью отключить дорогущую машину от текущих задач и заниматься только ее тестированием на протяжении 25-30 часов. Если же говорить о масштабе экзафлопсов, то на аналогичное стандартное LINPACK-тестирование потребуется от пяти до шести дней. Даже с чисто организационной точки зрения решиться на подобное расточительство будет чрезвычайно сложно.

Куда более тяжкий и принципиально важный барьер — это уже упомянутые ранее тотальные проблемы с питанием. Нынешние машины-чемпионы масштабируемы в смысле производительности, однако здания, поставщики энергии и так далее — аналогичным образом не масштабируются. Отмечающаяся ныне тенденция к улучшению эффективности по питанию — это, к сожалению, в действительности сугубо одноразовая выгода, которая появилась в 2010 году благодаря переходу на многоядерные и акселераторные архитектуры. Но эта тенденция не является самоподдерживающейся и не сохранится, если не появится существенно иная, новая технология. Из того же, что имеется, уже выжато все возможное...

И это далеко не все. Совершенно ясно, что с ростом производительности перемещение данных будет стоить все больше и больше, нежели операции — флопсы — даже в пределах чипа. Фактически вместе с ростом скорости операций, количество памяти относительно уменьшается, поддаваясь масштабированию намного хуже, чем скорость вычислений. Это представляет собой серьезнейшую проблему, решением которой пока что всерьез никто не занимается. Однако в будущем, к 2018 году и далее, эта проблема будет только усугубляться.

Более того, для перехода к вычислениям экзамасштаба, уверен Саймон, настоятельно требуется менять всю нынешнюю парадигму программирования. Потому что нынешние модели вычислений и системы программирования имеют совершенно не те цели. В старой парадигме главным ограничителем производительности была пиковая тактовая частота; флопсы были самой дорогостоящим элементом системы, так что именно они оптимизировались для вычислений; для масштабирования памяти поддерживалось простое соотношение байт на флопс в терминах емкости и пропускной полосы, а в условиях однородных архитектур надежность рассматривалась как проблема аппаратного обеспечения.

В новой парадигме все выглядит иначе. Теперь энергопотребление — это главное конструктивное ограничение для будущих системных архитектур, а значит, в первую очередь необходимо минимизировать перемещение данных. Другое ограничение — масштабирование памяти, когда скорость вычислений возрастает в два раза быстрее, чем емкость памяти или ширина пропускной полосы. В целом архитектурная неоднородность систем будет лишь нарастать, поэтому в аспектах надежности уже не приходится рассчитывать на одну лишь аппаратную защиту. Короче говоря, эта «новая реальность» наиболее мощных суперкомпьютеров фундаментально разрушает нынешнюю парадигму программирования и всю вычислительную экосистему...

Цель публичных выступлений Саймона с этими прогнозами-предупреждениями, в общем-то, совершенно понятна. Трезво оценив тенденции и сделав безрадостные выводы о «срыве графика» по достижению экзафлопса, ученый очень бы хотел, чтобы это воспринималось всеми нормально-спокойно и конструктивно. Как, скажем, естественный, но непростой переход к новым рубежам. Но отнюдь не как «катастрофический провал» весьма дорогостоящих научных исследований и разработок.

Теги: Суперкомпьютер, Масштабирование, Тера, Экза, Флопс, ТОП500, Прогнозы

Категория: Наука » Компьютеры » Обзоры

| 30-05-2013, 23:03 | Просмотров: 3 994 | Комментарии (0)